创业邦(ID:ichuangyebang)原创

作者丨洪雨晗

编辑丨昝立永

图源丨英伟达

北京时间2023年3月23日早晨,当你起床查看美股收盘时,你会发现英伟达的市值已经超越了特斯拉,离伯克希尔哈撒韦只有百亿美元的差距。如果英伟达保持这种势头,它将超越巴菲特的伯克希尔,成为全球最具价值的前5大公司。

是什么让英伟达有如此气势?也许3月21日晚的那场发布会里有答案。

2023年3月21日晚11点,全世界人工智能的热潮似乎迎来了它爆发的顶点。

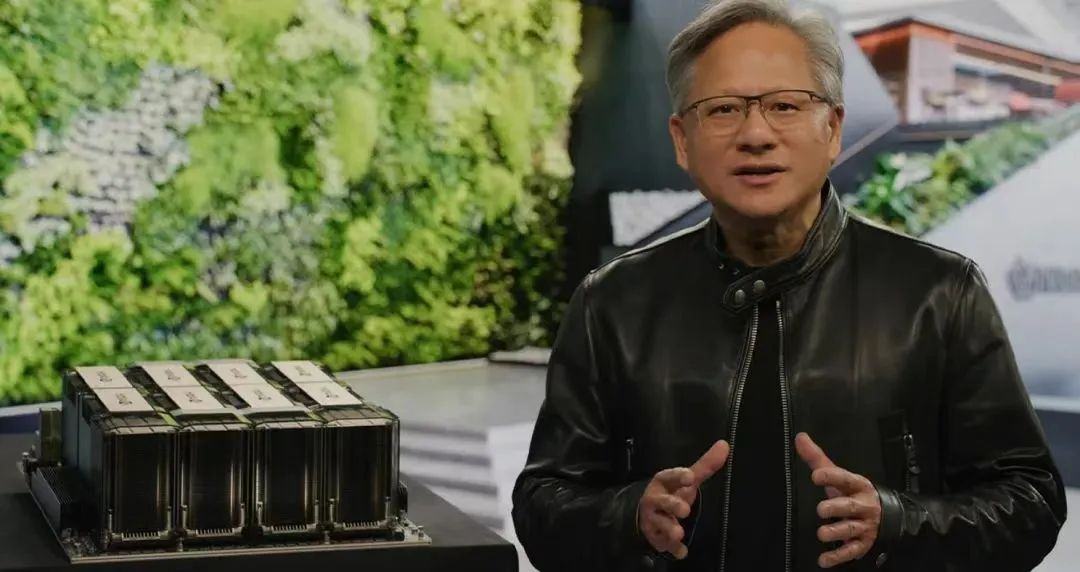

英伟达创始人兼CEO黄仁勋在2023 GPU技术大会激昂的宣布:“AI 正迎来有史以来最辉煌的时刻。新的 AI 技术和迅速蔓延的应用正在改变科学和各行各业,并为成千上万的新公司开辟新的疆域。这将是我们迄今为止最重要的一次GTC。”

在英伟达第14次GTC大会上,黄仁勋用了78分钟的演讲时间,发布了全新的GPU推理平台、AI超级计算服务DGX Cloud、云服务及代工厂NVIDIA AI Foundations、与Quantum Machines合作推出首个GPU加速的量子计算系统以及推动芯片突破物理极限的CuLitho光刻技术等。

就是因为这些行业领先的技术,英伟达似乎从来不在乎什么风口,但这几年来又从没有离开过风口,从游戏、数据中心、云、半导体、加密货币再到最近的元宇宙和ChatGPT,可以说所有资本热捧的风口后面都有英伟达的影子,成为AI以及硬件时代的“卖铲人”。

用黄仁勋的话来形容就是“AI的iPhone时刻已经到来”,这次GTC英伟达用其强大软算力产品,用来支持ChatGPT这般划时代的AI,而国内的企业似乎难以搭上这次AI时代的快车。

算力垄断

人工智能时代最重要的东西就是训练AI所需的数据和算力,数据几乎无法被一家公司垄断,但很明显,算力属于英伟达。

深度学习的发展历史和英伟达一直关系很深。十年前,在训练促进深度学习迅猛发展的AlexNe神经网络,用的正是英伟达旗下的GeForce GTX 580显卡;十年后,ChatGPT背后的大模型GPT3,及GPT3.5同样没有离开英伟达,使用的是英伟达的DGX AI 超级计算机。不同的是,十年间两种模型所需的运算量已相差了一百万倍,人工智能也实现了跨越式的发展,ChatGPT震惊了世界。

这其中极为重要的一环就是GPU算力的提高、运算成本的下降,而芯片在背后更是发挥了无可取代的作用。

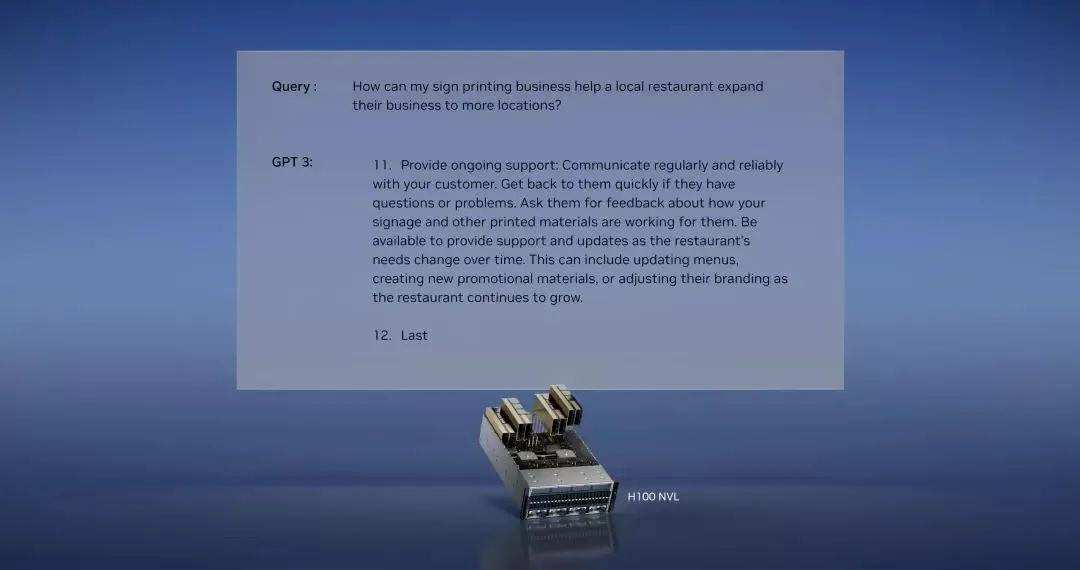

为了支持像 ChatGPT 这样的大型语言模型推理,黄仁勋在此次GTC上发布了一款新的 GPU——带有双 GPU NVlink 的 H100 NVL。基于 NVIDIA Hopper 架构的 H100 配有一个 Transformer 引擎,旨在处理驱动 ChatGPT 的类似 GPT 模型。与用于 GPT-3 处理的 HGX A100 相比,配备四对 H100 与双 GPU NVlink 的标准服务器的速度最高可达 10 倍。

黄仁勋表示:“ H100 可以将大型语言模型的处理成本降低一个数量级。”

八个H100的GPU便可以组成成一个巨大的DGX AI 超级计算机GPU,目前不少海外互联网大厂正在用这款超级计算机来训练自己的大模型。

比如,上周微软发布了其 H100 虚拟机 ND H100 v5 的私人预览版;meta 现已为其内部的 AI 生产和研究团队部署了由 H100 驱动的 Grand Teton AI 超级计算机;OpenAI 将在其 Azure 超级计算机上使用 H100 来支持其持续进行的 AI 研究。此外,Google Cloud、Lambda、Paperspace 和 Vult 都计划使用H100。

H100 NVL将AI算力提高了10倍,但中国企业却与其无缘。早在2022年8月,美国监管机构就以国家安全为由,对英伟达的 A100、H100两款GPU实施禁令,不得销售给中国和俄罗斯企业,并要求英伟达出口给中国的最高算力产品性能不得高于 A100。

这意味着英伟达本次GTC上,H100 NVL、DGX AI 超级计算机等大部分硬件产品,中国的科技公司只有眼馋的份,能流向中国的只有H100的阉割版H800。

四座大山

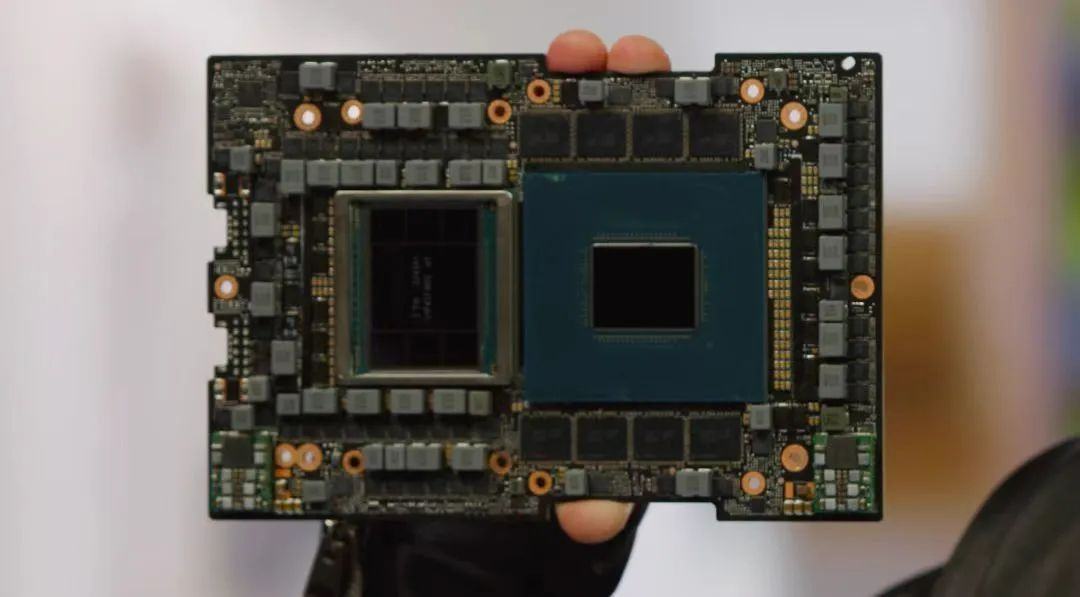

以H100 为代表的GPU仍需其内核中的先进制程芯片作为支撑,英伟达要想成为AI领域的台积电,就不能将所有先进制程芯片的制作都交由台积电,必须有自己的专利壁垒。

在此次GTC上,黄仁勋宣布通过与芯片制造巨头台积电、光刻巨头ASML以及EDA巨头Synopsys的合作,英伟达将加速计算引入计算光刻技术领域,推出了够加快新一代芯片的设计和制造的NVIDIA cuLitho技术。

黄仁勋表示:“芯片行业是全球几乎所有其他行业的基础。光刻技术已临近物理极限,NVIDIA cuLitho 的推出以及我们与 TSMC、ASML 和 Synopsys 的合作,使晶圆厂能够提高产量、减少碳足迹并为 2 纳米及更高工艺奠定基础。”

这项技术实际带来的变化肉眼可见,cuLitho 在 GPU 上运行,其性能比当前光刻技术工艺提高了 40 倍,大大减少了目前每年消耗数百亿 CPU 小时的大规模计算工作负担。通过这项技术,500 个 NVIDIA DGX H100 系统就能完成过去需要 4 万个 CPU 系统才能完成的工作,同时还减少了半导体制造对电量的巨额消耗(电费是不少数据中心的成本大头)。

芯片的制造本质仍属于一个经济问题,目前AIGC寻求商业变现的关键也是降低算力成本。英伟达给出了一个cuLitho直观的数据,使用 cuLitho 的晶圆厂每天的光掩模产量可增加3-5 倍,而耗电量可以比当前配置降低 9 倍,光掩模的生产从两周缩短至一天不到的时间。

近年来,由于增长的新节点晶体管数量以及更加严格的精度要求,半导体制造中的超大型工作负载所需的计算时间成本已经超过了摩尔定律。未来的节点需要更加详细的计算,但不是所有计算都能适应当前平台所提供的可用计算带宽,这会减缓半导体行业的创新步伐。

一般情况下,晶圆厂在改变工艺时需要修改 OPC,因此会遇到瓶颈。cuLitho 不仅可以帮助突破这些瓶颈,还可以提供曲线式光掩模、High-NA EUV 光刻、亚原子光刻胶建模等新技术节点所需的新型解决方案和创新技术。

ASML 首席执行官 Peter Wennink 表示:“我们计划在所有计算光刻软件产品中加入对 GPU 的支持。我们与 NVIDIA 在 GPU 和 cuLitho 上的合作预计会给计算光刻技术,乃至整个半导体行业的发展带来巨大的益处。这一点在 High-NA EUV 光刻时代将变得尤为明显。”台积电和Synopsys也会未来将这项技术用于其产品当中。

过去,半导体行业市场感叹,我国缺少ASML的High-NA EUV 光刻机、台积电5nm及以下的先进制造能力还有Synopsys强大的EDA软件,美国通过遏制这些尖端软硬件的出口来限制我国在半导体领域的追赶。

如今,在台积电、ASML和Synopsys之后,英伟达成为了第四座大山。

时间太紧迫了,中国的半导体产业在近几年从成熟制程到先进制程一步步走,各细分产业赛道也有一批解决“卡脖子”痛点的企业涌现,但随着 ChatGPT 的横空出世以及黄仁勋说的“AI的iPhone时刻已经到来”,AI进步的速度一日千里,但国内的算力基础设施却难以跟上AI飞速发展的脚步。

没有足够便宜、足够多的算力,意味开发者在做中国大模型时需要烧更多的钱,无形提高了研发成本,那么到AI产品的应用层上,初创企业所需成本更高,甚至亏本赚吆喝,无法形成健康的商业正循环。

这么看来,在人工智能时代,英伟达是AI时代的台积电真的不是一个玩笑。