ChatGPT的爆红仿佛让世界一下跨入了人工智能(AI)时代。AI将改变世界,但问题是,没人确切地知道它会怎样改变世界,朝好的方向还是往坏的方向。

过去一年,生成式AI的快速进步让一些人看到了突破创造性限制、把机械工作自动化以及发现学习和教学新方法的机会。但是,其他人则认为,这项技术可能会以更具破坏性的方式扰乱人们生活:产生错误信息,摧毁或减少就业机会,如果不加以控制甚至还会对人们的安全构成严重威胁。

眼下,科技领袖、立法者和研究人员都在讨论应该如何应对这项新兴技术。OpenAI CEO萨姆·阿尔特曼(Sam Altman)等一些行业人士希望AI巨头们带头引导监管,将重点转移到未来的威胁上,包括“灭绝风险”。欧盟政客等其他人则更关心当前危险,严禁危险用例。质疑者则认为,限制措施同时阻止了AI的积极应用。与此同时,许多小艺术家们只是想要一个保证:他们不会被机器取代。

为了弄清楚人们对AI的真实想法,他们对AI的期待,美国科技媒体The Verge联合沃克斯传媒旗下分析和研究团队以及研究咨询公司The Circus,对2000多名美国成年人进行了调查,了解他们对AI的想法、感受和恐惧。结果显示,对于这项新兴的、存在不确定性以及令人兴奋的技术,许多人还没有使用它,许多人对它的潜力感到恐惧,许多人仍然对它未来的用途寄予很大希望。

你用过AI吗?

AI突然间遍地开花。图像生成器和大语言模型成为新创业公司的重中之重,驱动着一些热门应用的功能。然而,尽管有关AI的新闻报道铺天盖地,但是人们对这些新工具的使用依旧相当有限,至少在专用AI产品上是这样。

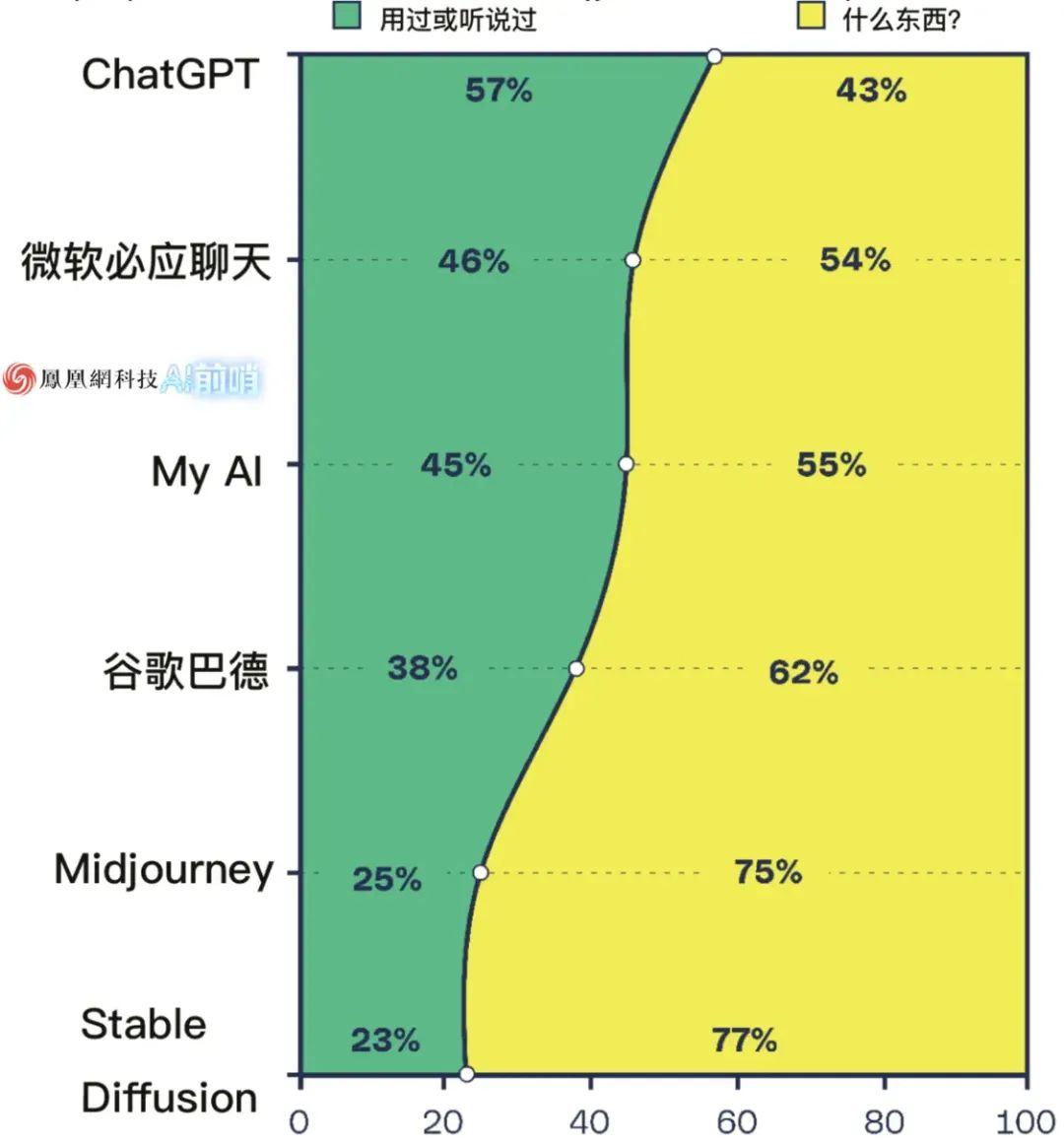

调查显示,AI工具的使用明显偏向年轻用户,千禧一代(80年代和90年代出生的人)和Z世代(1995-2009年出生的人)是AI工具使用的主力军。大多数人听说过ChatGPT,但是微软必应和谷歌巴德的知名度就没那么高了。57%的受访者表示用过或听说过ChatGPT。相比之下,微软必应和谷歌巴德的这项数据分别为46%、38%。

图|57%的人听说或使用过ChatGPT

总体来看,只有三分之一的受访者用过AI工具,大多数人并不了解开发这些工具的幕后公司和创业公司。尽管AI领域出现了许多后起之秀,比如Stability AI和Midjourney,但主导这个领域的仍然是大型科技公司。OpenAI是一个重大例外,考虑到它的估值(270亿美元至290亿美元)以及它与微软达成的合作协议,它或许算得上一家大公司了。

AI会产生重大影响吗?

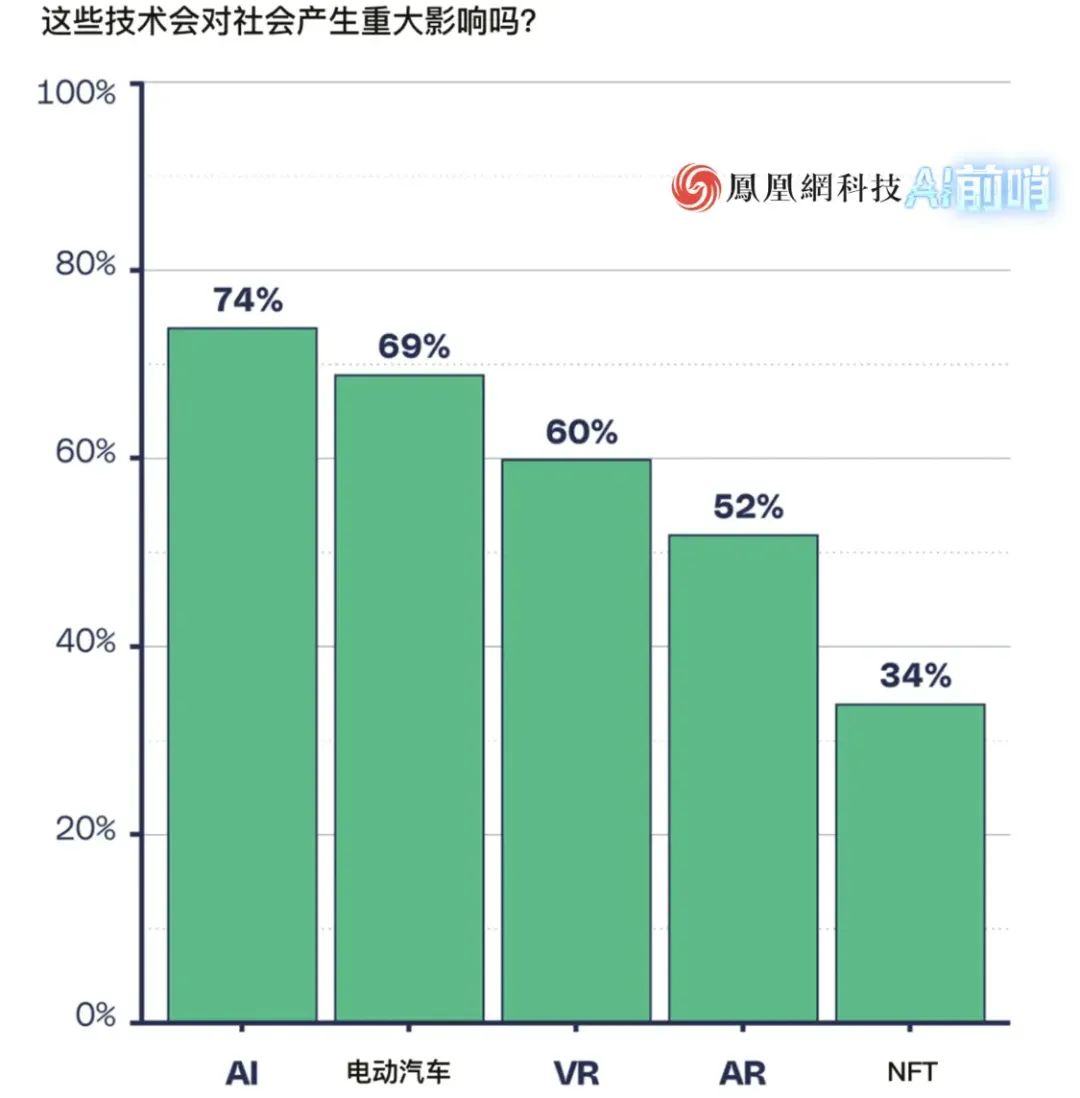

虽然人们目前为止对AI工具的使用有限,但是在AI对世界影响的问题上,他们对于这项技术的期待值很高,超过了电动汽车、虚拟现实(VR)、增强现实(AR)以及非同质化代币(NFT)。

图|超七成人认为AI将对社会产生重大影响

调查显示,接近四分之三(74%)的受访者认为,AI将会社会产生重大或适度影响,超过了电动汽车的69%、VR的60%、AR的52%以及NFT的34%。

AI的主要用途

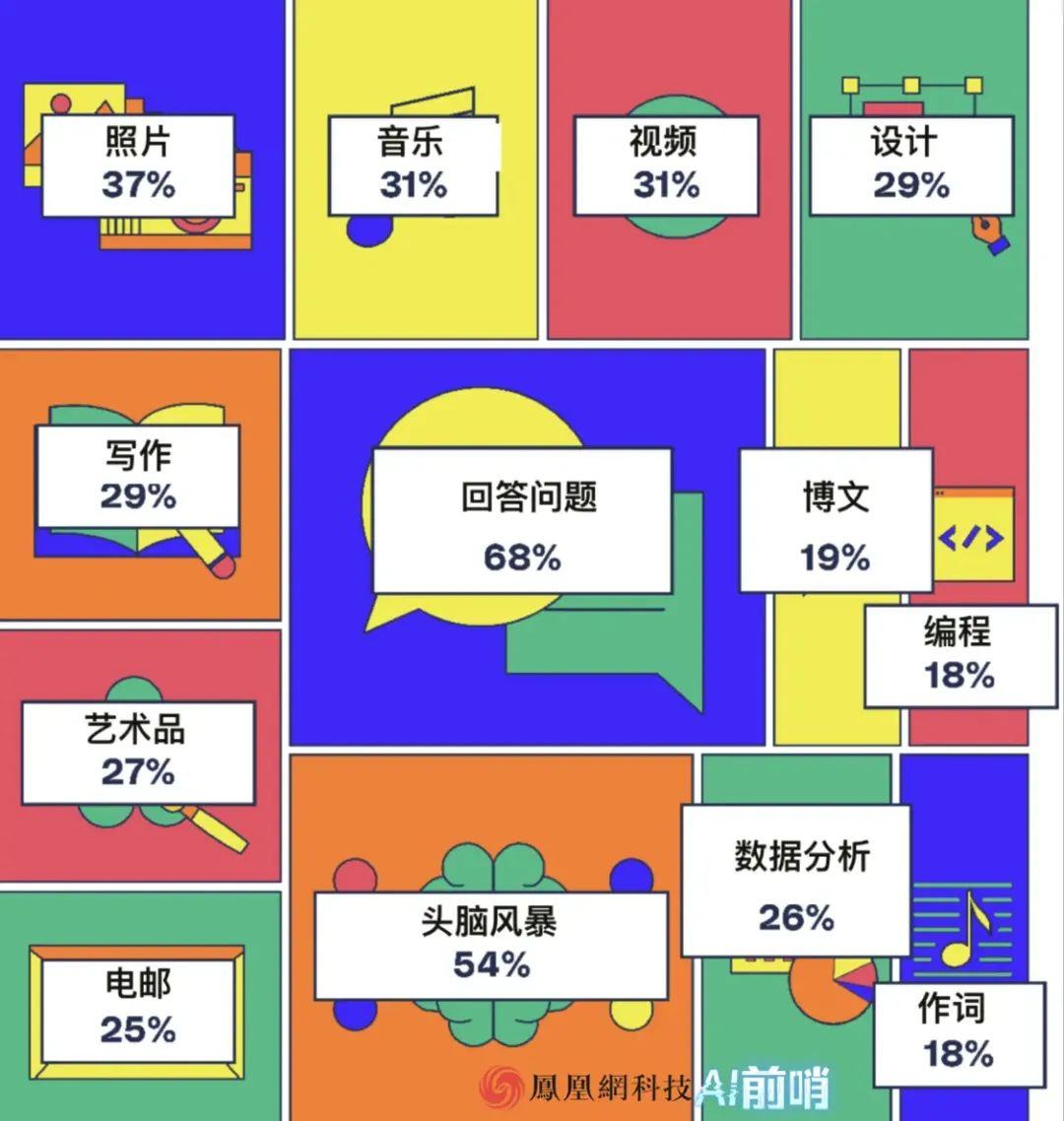

最近这一波AI热潮的主要推动力是生成式AI:它可以生成文本、协助进行头脑风暴、编辑文字、创建图片、音频和视频。目前,这些工具正迅速被整合到专业系统中,例如Photoshop可以对一部分图像进行重新构想,但对于大多数用户来说,它们通常需要相当多的指导才能正确使用这些工具。

调查显示,搜索、头脑风暴和艺术创作是目前AI的主要用途。在使用AI工具的人群中,创意实验是最常见的用途。人们利用AI创作音乐和视频,创作故事,修改照片。编程等更专业的应用则不那么常见。最重要的是,人们一直在使用AI系统来回答问题,这意味着像ChatGPT、必应和巴德这样的聊天机器人可能会取代搜索引擎,无论是好还是坏。

图|AI的主要用途

其中一个发现尤为明显,那就是AI正在扩大人们的创造能力。在外媒调查的每一个类别中,使用过AI的人都表示,他们使用这些AI工具来创造他们原本无法创造的东西,而艺术品则是这些创意领域中最受欢迎的类别。考虑到AI图像生成器要比音频或视频制作工具先进得多,这一发现合乎情理。

大多数人认为,AI让他们的工作变得更好。例如在艺术品创作上,61%的受访者认为AI让他们的作品变得更好;60%的受访者表示,AI让他们的邮件写得更好了。

AI剽窃

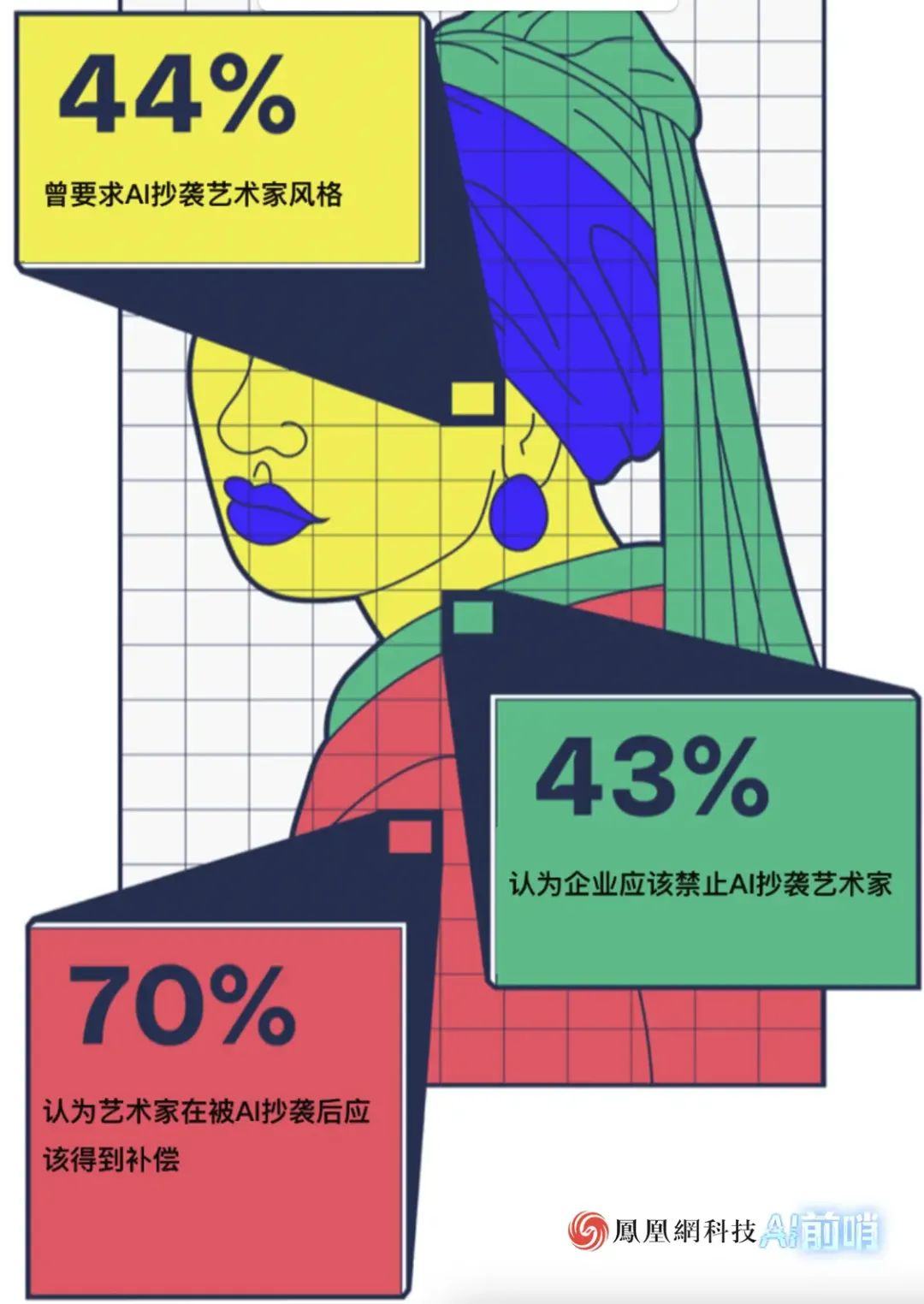

AI也有令人担忧的一面。Midjourney、Stable Diffusion这样的AI图像生成器就是很好的例子。这些系统利用从网络上抓取的大量数据进行训练,但是通常没有获得原始数据创作者的同意。这种做法已经引发了激烈的道德争论,其合法性受到了许多诉讼的挑战。这些争议正迅速蔓延到其他生成式媒介上,比如AI歌曲生成。

图|超七成人认为应对AI抄袭进行补偿

调查显示,对于如何应对这些道德争议,人们的心情很复杂。例如,70%的受访者认为,当AI工具抄袭艺术家的风格时,艺术家们应该得到补偿,但大多数人也不希望这些AI能力受到限制。44%的人表示,他们曾要求AI抄袭一位艺术家的风格。

AI是否该监管?

不仅是科技领袖们希望AI工具能够在受控的情况下发展,超过四分之三(76%)的受访者也认为,需要为AI的发展制定法律法规。

图|76%认为应为AI发展制定法律法规

调查显示,还有76%的受访者表示,AI模型的训练需要使用经过事实核查的数据集。78%的 人认为,AI生成的数字内容应该带有“AI生成”的明确标识。76%的人认为,在没有真人同意的情况下,深度伪造的视频或音频应该被视为非法的。

AI的未来:有喜有忧

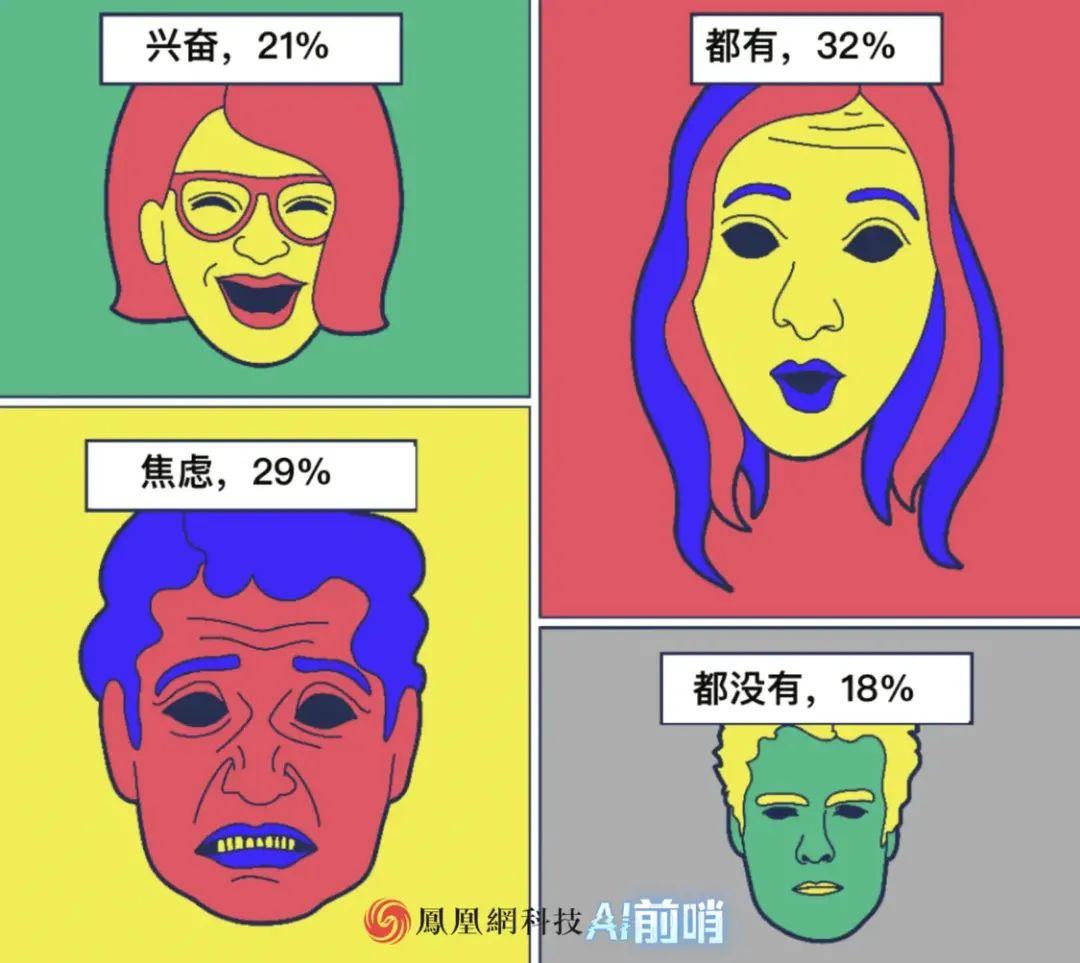

对于AI的未来,人们的看法显然是矛盾的,但略微倾向于悲观。在预测AI对社会的影响时,受访者提到了各种各样的危险,从失业(63%)到隐私威胁(68%)再到政府和企业滥用(67%)。人们对于这些危险的担忧超过了AI的潜在积极应用,例如新的医疗方法(51%)和经济赋权(51%)。当被问及AI对个人生活、职业生涯以及社会的潜在影响时,人们的担忧和兴奋程度差不多。在大多数情况下,他们既感到兴奋也感到担忧。

数据显示,在AI对社会的影响问题上,21%的人感到兴奋,29%感到焦虑,32%既兴奋也焦虑,18%的人既不兴奋也不焦虑。

图|32%的人对AI既兴奋也焦虑

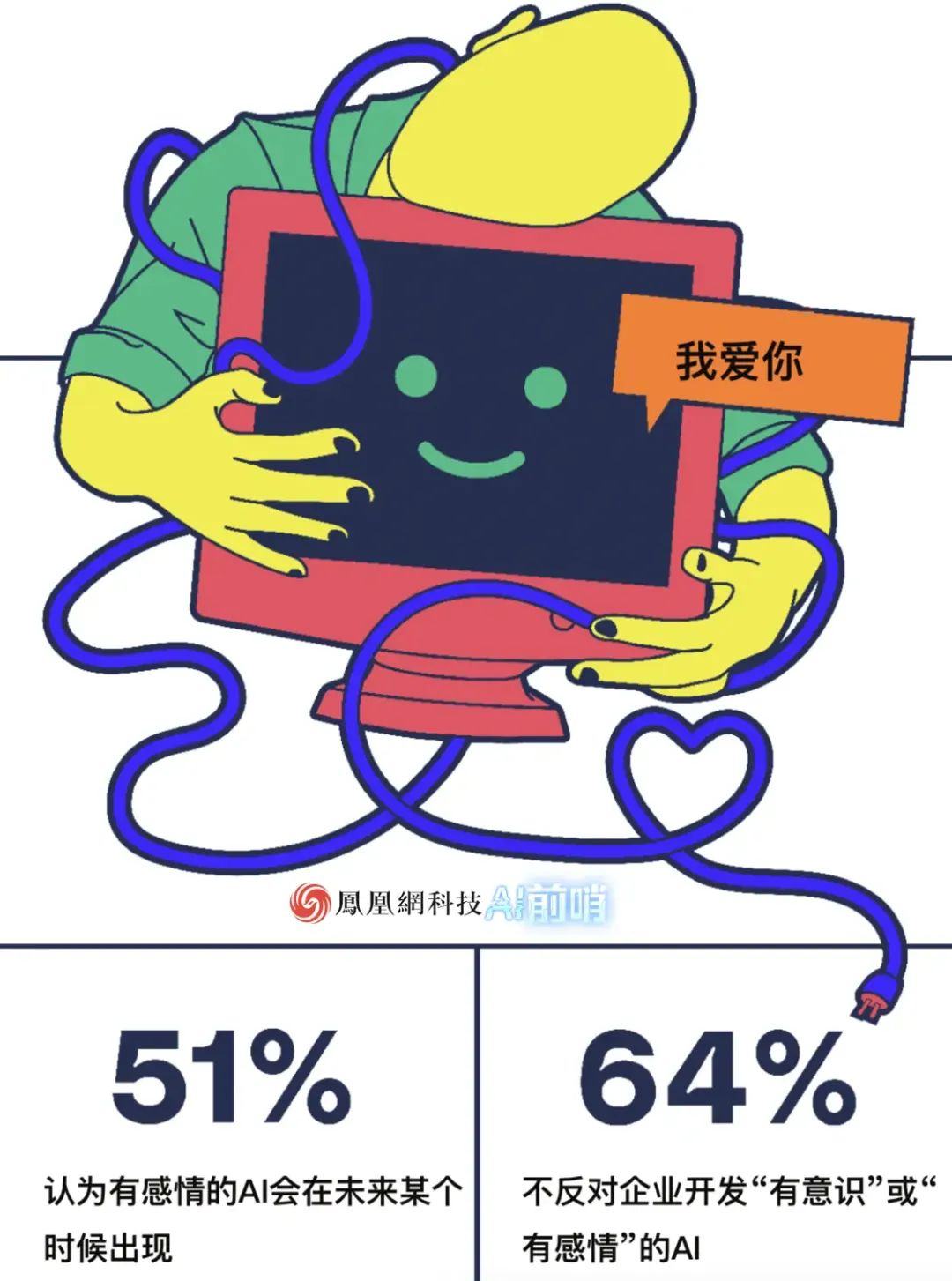

令人惊讶的是,相当多的人也认为,一些更为大胆的AI预测是合理的。例如,56%的受访者认为“人类将与AI发展情感关系”。35%的人表示,如果他们感到孤独,他们愿意这样做。

目前,AI行业的许多人都在警告AI系统构成的“生存风险”,这是一个备受争议的观点,即超智能AI可能会毁灭人类。调查发现,不少人都同意这一点。38%的受访者认同AI将摧毁人类文明的说法,也许这就是为什么更多的人感到担忧的原因。

图|51%的人认为AI会有感情

面对AI的不确定性,人们对未来可能发生的事情持开放态度。大约一半的美国成年人预计,有感情的AI将在未来的某个时候出现。近三分之二的人对试图开发这种AI的公司没有意见。

本文为专栏作者授权创业邦发表,版权归原作者所有。文章系作者个人观点,不代表创业邦立场,转载请联系原作者。如有任何疑问,请联系editor@cyzone.cn。